2026-04-12 36

先说系统win11,CPU:amd的5600 显卡:2080TI 22GB

自从claude code的源码泄漏后,网上有好多反编译的,有能用的也有不能用,我自己也测试好了多,

最后这位能用:https://github.com/NanmiCoder/cc-haha

基本功能差不多,电子宠物啥的还没试。

一安装:

按照他上面的部署流程是:

# macOS / Linuxcurl -fsSL https://bun.sh/install | bash

# macOS (Homebrew)brew install bun

# Windows (PowerShell)powershell -c "irm bun.sh/install.ps1 | iex"精简版 Linux 如提示

unzip is required,先运行apt update && apt install -y unzip

bun install

cp .env.example .env# 编辑

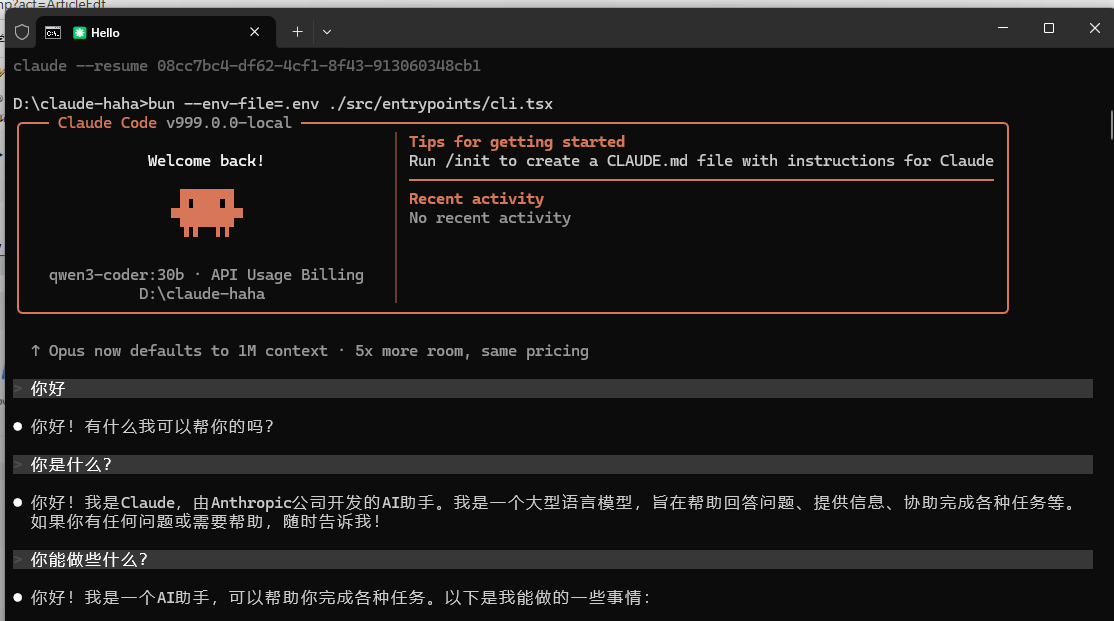

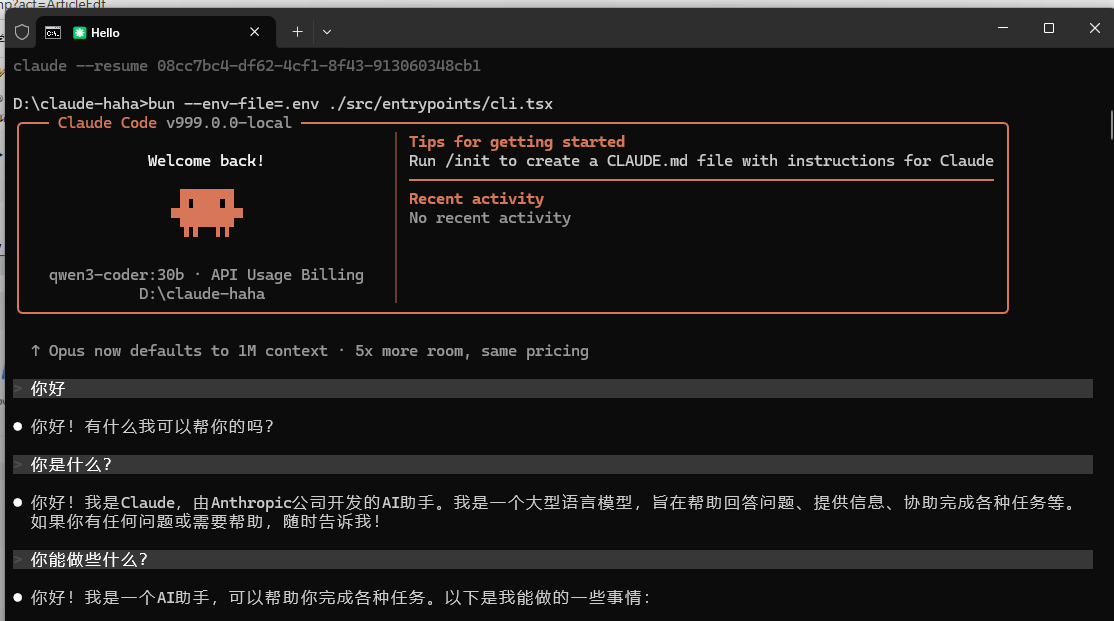

.env 填入你的 API Key,详见 docs/guide/env-vars.md./bin/claude-haha # 交互 TUI 模式

./bin/claude-haha -p "your prompt here" # 无头模式

./bin/claude-haha --help # 查看所有选项前置要求:必须安装 Git for Windows

# PowerShell / cmd 直接调用 Bunbun --env-file=.env ./src/entrypoints/cli.tsx# 或在 Git Bash 中运行./bin/claude-haha将 bin/ 加入 PATH 后可在任意目录启动,详见 全局使用指南:

export PATH="$HOME/path/to/claude-code-haha/bin:$PATH"以上就部署完了,启动前,创建一个 .env的文件

里面写:

ANTHROPIC_AUTH_TOKEN=ollama ANTHROPIC_BASE_URL=http://localhost:11434 ANTHROPIC_MODEL=qwen3-coder:30b ANTHROPIC_DEFAULT_SONNET_MODEL=qwen3-coder:30b ANTHROPIC_DEFAULT_HAIKU_MODEL=qwen3-coder:30b ANTHROPIC_DEFAULT_OPUS_MODEL=qwen3-coder:30b API_TIMEOUT_MS=3000000 DISABLE_TELEMETRY=1 CLAUDE_CODE_DISABLE_NONESSENTIAL_TRAFFIC=1

里面qwen3-coder:30b是我在ollama上使用的模型,写代码比较好用,对于我的电脑配置反映还算快

二、然后就是下载ollama

ollama不多讲了,一般人应该都会用了

提一嘴,最好把ollama安装到固态上,速度会快,亲测比机械硬盘要快好多

要把ollama安装到别的盘的方法是:

新建变量:在“系统变量”中新建变量,变量名为 OLLAMA_MODELS,变量值为 D 盘模型目录(如 D:\Ollama\models)这样就直接部署在D盘了。

主要是讲一下我踩的坑,根据GITHUB上讲的话需要litellm转接一下才行,结果win11上配置litellm巨难配置,不是不兼容就是链接不对,整了三天差点崩溃

claude-code-haha ──Anthropic协议──▶ LiteLLM Proxy ──OpenAI协议──▶ 目标模型 API (协议转换)

后来才知道,其实根本不用Litellm

ollama在0.14.0版本以后支持OPENai协议了,直接上就完事了,也不知道这个博主是不是OUT了。属于节外生枝了。

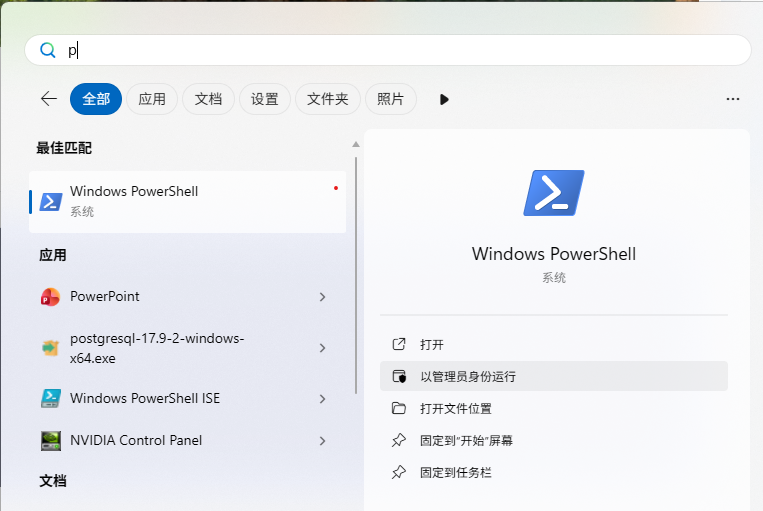

点击以管理员运行

然后输入

# 指向 Ollama 本地地址 $env:ANTHROPIC_BASE_URL = "http://localhost:11434" # 固定填 ollama $env:ANTHROPIC_AUTH_TOKEN = "ollama"

在启动以上部署的claude code

ollama中的大模型,它就直接可以条用了,简单省事。

不容易啊,有些时候还是得自己多想想!~

原文链接:http://www.58isp.com/?id=53

=========================================

http://www.58isp.com/ 为 “北京联锐信通网络” 唯一官方服务平台,请勿相信其他任何渠道。

内网管理 2023-05-02

内网管理 2022-11-12

网络小工具 2022-10-25

内网管理 2022-11-10

网络小工具 2022-11-11

内网管理 2023-08-06

ISP 2025-06-17

内网管理 2023-01-30

内网管理 2023-05-17

内网管理 2024-10-12

游客 2025年04月16日

博主 2025年04月16日

小游客 2025年04月16日

博主 2024年11月05日

小游客 2024年10月25日

扫码二维码

获取最新动态